Facebook a déclenché son dispositif d’alerte “safety check” à Bangkok, après la publication d’un article sur une explosion dans la capitale thaïlandaise, qui remontait en réalité à 2015. Une affaire qui relance la polémique sur les "fake news".

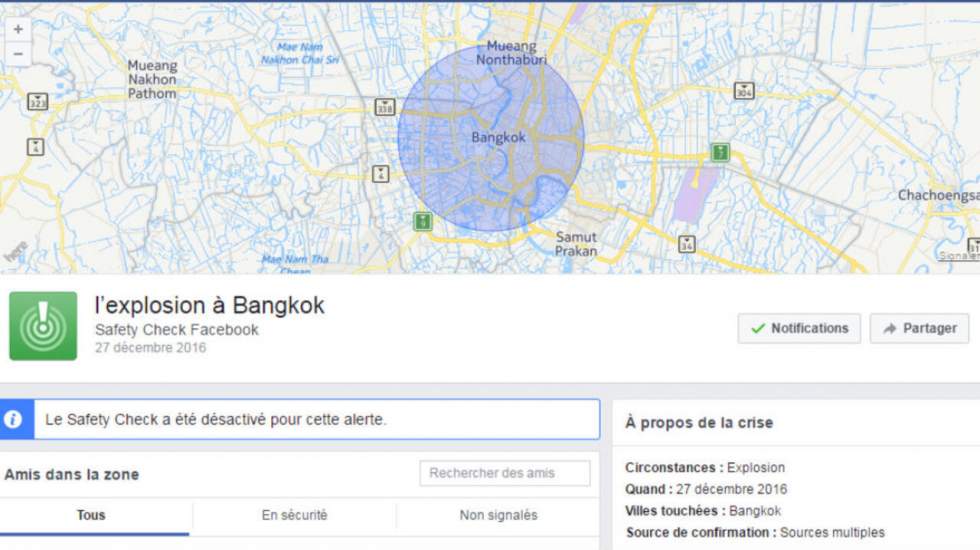

Facebook vient de nouveau de se prendre les pieds dans son problème récurrent de “fake news” (informations trompeuses). Cette fois-ci, le réseau social a activé par erreur son dispositif de “safety check” – qui permet aux utilisateurs de rassurer leurs amis en cas de catastrophe naturelle ou d’attentat – en Thaïlande peu après la publication d’un article sur une explosion à Bangkok, mardi 27 décembre. Pourtant, aucune bombe n’avait explosé dans la capitale thaïlandaise. Il a fallu plus d’une heure à Facebook pour désactiver le safety check.

L’alerte initiale envoyée par le réseau social était accompagnée, pour tout contexte, d’un article, intitulé “Thaïlande : une explosion secoue le cœur de Bangkok”, repris par plusieurs sites, dont le portail d’information MSN Asie de Microsoft. L’article original consistait en un simple lien qui renvoyait vers une vidéo de la BBC… mise en ligne le 17 août 2015 au sujet d’un attentat au sanctuaire hindouiste d’Erawan dans la capitale thaïlandaise.

Balles de ping pong et pétards

Bangkokinformer.com, qui a publié cette fausse information, est un portail qui se contente de reprendre des informations glanées par ailleurs sur le Web. S’est-il trompé où s’agit-il d’une tentative de désinformation ? Difficile à dire. Quoi qu’il en soit, il est en maintenance depuis l’incident.

Contacté par le site américain The Verge, Facebook nie s’être fait dupé par une “fake news”. Il affirme que son “safety check” s’est activé automatiquement après que “la communauté des utilisateurs et des sites tiers de confiance” ont fait circuler sur le réseau social des informations au sujet de “bombes” à Bangkok. En l'occurrence, il s’agirait d’un homme qui se tenait sur le toit d’une banque, non loin du bureau du Premier ministre, muni de balles de ping-pong chargées avec des pétards. Plusieurs publications locales ont relaté cet incident le 26 décembre faisant état de “pig pong bombs”. D’où la confusion ?

Pourtant la notification de l’activation du “safety check” renvoyait sur l’information trompeuse publiée par Bangkokinformer.com. La faute, en fait, en incomberait à l’algorithme de Facebook. Il choisit automatiquement les articles sur la base de plusieurs critères, dont la popularité, qui pourraient avoir un lien avec l’alerte. Avec plus de 500 partages, la “fake news” au sujet du vieil attentat a remporté la mise aux yeux de l’intelligence artificielle du réseau social.

Fausses news, vraies paniques ?

Un pataquès qui renvoie Facebook à ses deux principaux démons de 2016. Le réseau social a été accusé, notamment à l’occasion de l’élection présidentielle américaine, de favoriser la propagation d’informations trompeuses au risque d’influencer les électeurs. Après avoir tenté de minimiser le phénomène, Mark Zuckerberg, le PDG de Facebook, a finalement accepté, le 15 décembre, de s’associer à plusieurs médias de références (ABCNews, l’agence AP ou le site FactCheck) pour traquer les fakes news.

Le réseau social a aussi été critiqué pour avoir remis l’essentiel de ses activités éditoriales entre les mains, pas si expertes, de son algorithme maison. Ce dernier a joué un rôle central dans la propagation des fausses nouvelles en échouant à plusieurs reprises à déceler les informations trompeuses et en les propulsant tout en haut du fil d’actualité d’utilisateurs de Facebook. Les critiques ont été d’autant plus acerbes, qu’une équipe de journalistes s’occupait de hiérarchiser l’information et qu’ils ont tous été licenciés en août 2016.

Le raté de Bangkok démontre que les deux problèmes actuels de Facebook – les insuffisances de son algorithme et les “fake news” – ont des conséquences sur l’ensemble de ses services. Le “safety check”, introduit en 2014, ne s’activait à l’origine qu’en cas de catastrophe naturelle. Son utilisation a été étendue lors des attentats de Paris en novembre 2015. La question qui se pose après la fausse alerte en Thaïlande est de savoir si des internautes mal intentionnés peuvent abuser de ce dispositif conçu pour prouver que Facebook peut jouer un rôle positif en temps de crise.