Captures d'écran de résultats trompeurs de détecteurs obtenus en testant à la fois des images générées par IA de Jeffrey Epstein (à gauche) et de Nicolas Maduro (au centre), mais aussi des photos réelles, comme celle partagée par Rachida Dati sur X en octobre 2025 (à droite). © Montage Les Observateurs / France 24

Comment repérer une image générée par IA ? Face à l'amélioration constante des logiciels de génération d'image, les réflexes de détection que l'on pouvait encore mobiliser au début de l’essor de ces technologies - repérer des mains mal faites ou les visages incohérents - semblent déjà dépassés.

De nombreux internautes se tournent désormais vers des outils de détection. Gratuits et facilement accessibles en ligne, ils sont nombreux à promettre des résultats "fiables" et "précis". Mais ceux-ci s'avèrent parfois incorrects, voire trompeurs, lorsqu'on les teste sur des images générées par IA, mais aussi sur des images réelles.

Des "faux négatifs"

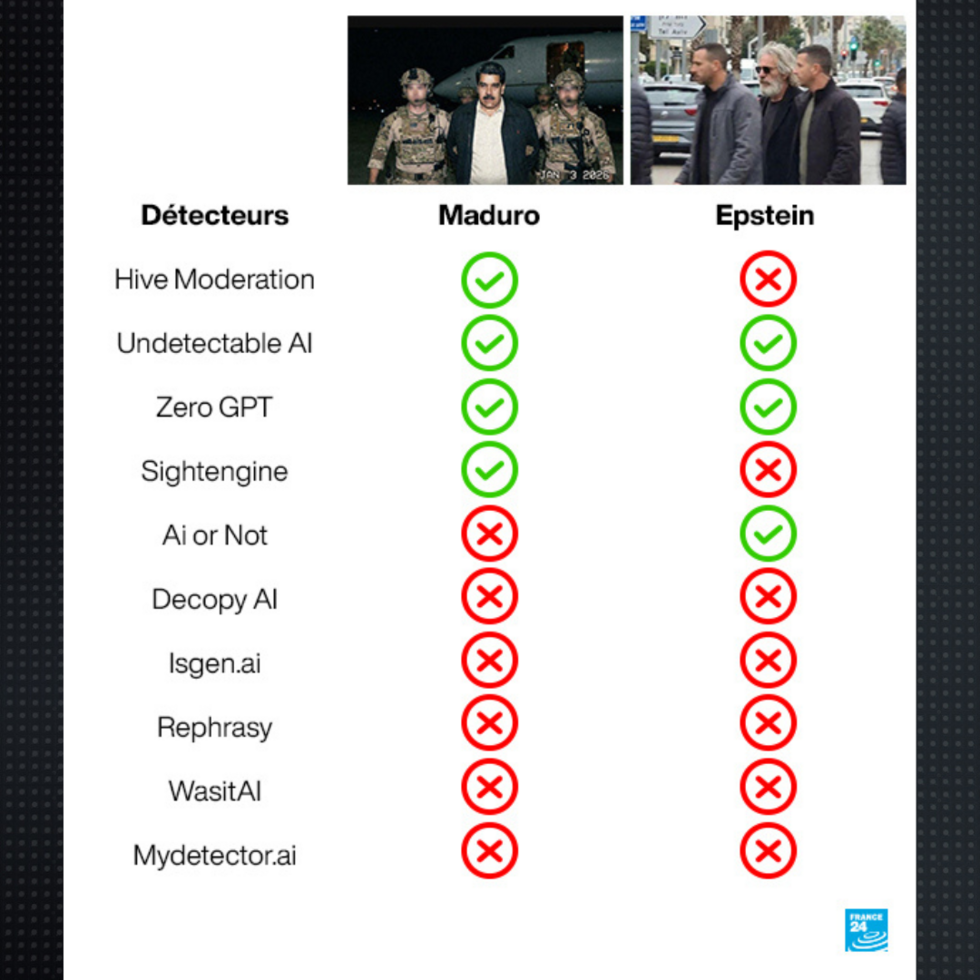

La rédaction des Observateurs de France 24 a testé les dix premiers détecteurs trouvés en ligne en tapant sur Google "détecteurs images IA", sur des images soit réelles, soit fausses. À chaque fois, plusieurs détecteurs se sont trompés dans leurs résultats.

C'est le cas par exemple des deux images générées par IA utilisées pour ce test, l'une censée montrer Nicolas Maduro et l'autre Jeffrey Epstein. Ces deux visuels, devenus viraux ces derniers mois et identifiés comme étant générés par IA par de nombreux médias de vérification (ici et ici), ont été identifiés comme générés par IA par moins de la moitié des détecteurs testés.

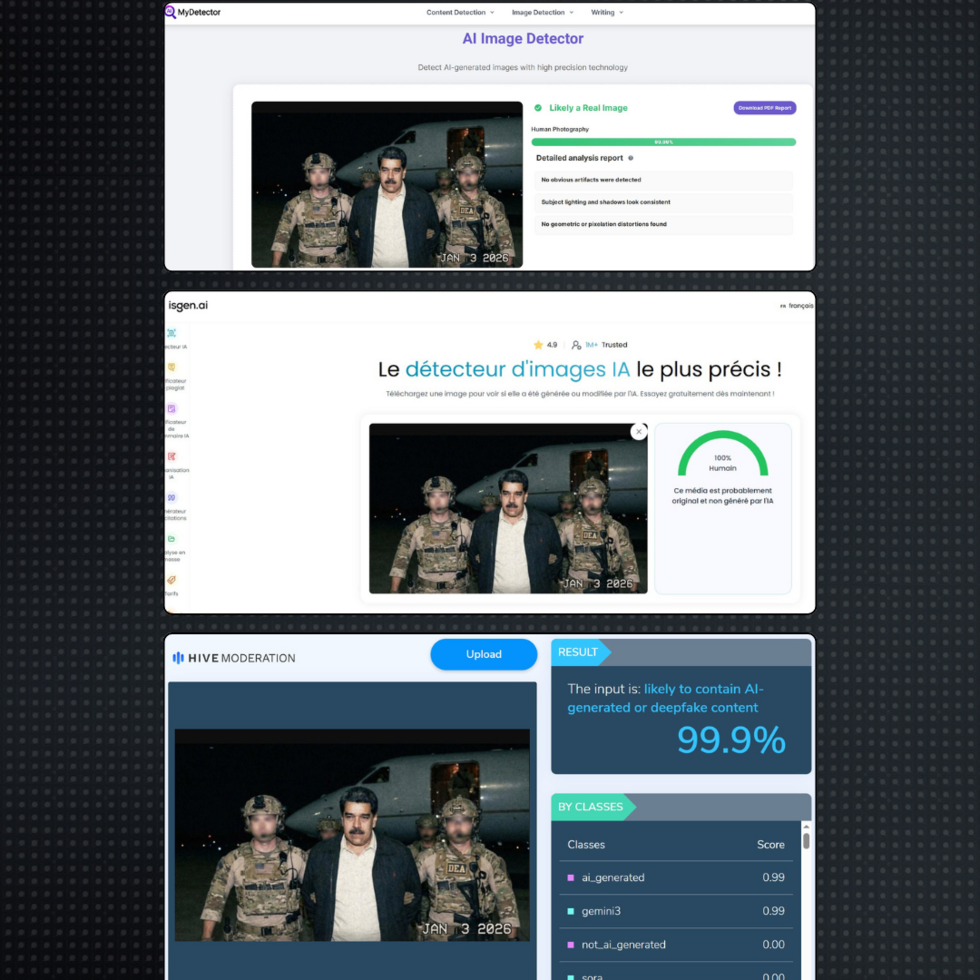

La première représentait le président vénézuélien Nicolas Maduro, capturé le 3 janvier par les États-Unis, sortant d'un avion entouré de deux soldats américains. Notre test montre que six outils sur dix, soit plus de la moitié, ont déclaré à tort que cette image était réelle. Parmi ces mauvais résultats, certains déclarent que le visuel est "100 % humain" (Isgen.ai), ou bien qu’il s’agit d’une "photographie humaine" à "99,99 %" (Mydetector.AI).

Même chose pour une image censée montrer le pédocriminel Jeffrey Epstein encore vivant à Tel Aviv en 2026 (il est décédé en détention en août 2019) : cette fois-ci, sept détecteurs n'ont pas établi qu'elle avait été générée par IA.

"Le développement de logiciels de détection par IA est complexe"

Ces cas où les outils échouent à identifier une image générée par IA - on les appelle des "faux négatifs" - s'expliquent par la manière même dont ces outils fonctionnent et sont "entraînés" : "la majorité des détecteurs d'IA en ligne fonctionnent comme des classificateurs : ils déterminent si une image est naturelle ou synthétique", explique Tina Nikoukhah, vice-présidente Recherche chez GetReal Security, entreprise de cybersécurité spécialisée dans la vérification de l’authenticité des personnes et des contenus numériques.

S'appuyant sur des algorithmes d'apprentissage automatique, ces outils sont entraînés sur des bases de données massives composées à la fois d'images réelles et d'images générées par IA. Mais dès lors, la qualité de ces outils dépend beaucoup des bases de données d'entraînement : "le développement de logiciels de détection par IA est complexe et parfois, les détecteurs d’IA n’ont pas été entraînés sur le type d'images que l'on veut analyser", explique Tina Nikoukhah.

La spécialiste met par exemple en avant la diversité des outils de génération d'images générées par IA - de l'outil Nano Banana de Google à Dall-E de ChatGPT, qui produisent chacun des types d'images particuliers. "Selon leur entraînement, des outils pourront par exemple être efficaces pour détecter les images créées par un générateur d’IA en particulier, mais pas par un autre".

Le cycle de vie des images en ligne joue également un rôle déterminant. Souvent redimensionnées, modifiées, compressées, ces images perdent au fur et à mesure certains signaux exploités par les détecteurs. Plusieurs entreprises à l'origine de ces outils, comme ZeroGPT ou Rephrasy, l’ont confirmé à notre rédaction. La même fausse image de Jeffrey Epstein vivant en 2026 en plan plus large est par exemple mieux détectée par certains détecteurs.

Difficile enfin de déterminer parfois ce que ces outils qui classifient entre Vrai et Faux ont réellement "appris" à travers leur entraînement : "En réalité, on ne sait parfois pas pourquoi un outil a détecté une image comme vraie ou fausse", poursuit Tina Nikoukhah. Par exemple, si j'entraîne mon outil à partir de beaucoup de photos générées par IA de drapeaux, peut-être que l'outil sera biaisé et classifiera plus facilement les photos de drapeaux comme fausses."

De vraies photos détectées à tort comme de l'IA

Pour Tina Nikoukhah, ces outils doivent en réalité s’inscrire dans un dispositif de détection plus large, reposant sur plusieurs algorithmes capables de s’adapter à différentes situations. “C’est comme en médecine : pour diagnostiquer une maladie, on ne se repose pas sur un seul examen, mais sur plusieurs techniques, de l’IRM au scanner.”

Plusieurs des outils interrogés reconnaissent ne pas pouvoir détecter toutes les images générées par IA. "Notre modèle peut parfois être susceptible de classer une image générée par IA comme provenant d'un humain", indique par exemple l'entreprise Isgen.IA, sollicitée par notre rédaction, dont l'outil n'a détecté aucune des deux images ci-dessus. "Mais en contrepartie, nous obtenons une précision nettement supérieure sur les images humaines. Cela nous permet de ne pas classer à tort des œuvres humaines, ce qui pourrait avoir des conséquences encore plus graves."

Car plusieurs des outils testés peuvent produire aussi ce qu'on appelle des "faux positifs", c'est-à-dire des résultats qui affirment à tort qu'une image réelle est générée par IA. Notre rédaction a fait le test avec plusieurs photos publiées en ligne par des personnalités politiques. Une photo d'Emmanuel Macron publiée lors d'une réunion de chefs d'État en décembre 2025 a par exemple été détectée par trois outils comme étant générée par IA.

Quatre outils ont également jugé fausse une photo publiée en octobre 2025 par le désormais maire de Paris, Emmanuel Grégoire. Pour l'ex-candidate aux municipales de mars 2026 à Paris Rachida Dati, ce sont même six outils qui ont affirmé à tort qu’une photo publiée sur son compte X vers la même période, était générée par IA.

Aucun de ces faux positifs n'a eu d'incidence sur le débat public. Mais ils peuvent poser problème : à cause de deux mauvais résultats d'outils de détection qui avaient détecté à tort de l'IA dans une photo publiée par Jean-Luc Mélenchon, le responsable de La France insoumise (LFI) avait été accusé d'avoir ajouté des drapeaux français sur un cliché montrant une manifestation contre l'islamophobie en mai 2025. La photo, bien réelle, avait été uniquement retouchée sur les contrastes et la luminosité par l'outil de retouche Adobe, qui utilise de plus en plus l'IA pour ce type de modification.

L'entreprise Sightengine, à l'origine d'un des faux positifs, avait à l'époque indiqué que son outil pouvait détecter à la fois "les images entièrement générées par IA, mais aussi les photos réelles qui comportent des éléments générés ou modifiés par IA" - sans toutefois préciser cette nuance dans les résultats présentés à un utilisateur qui ferait le test.

Combiner ces résultats à d'autres méthodes

Au-delà de ces résultats parfois faux, ces détecteurs sont aussi critiqués pour leur manque de transparence sur les résultats donnés par ces détecteurs et les raisons derrière leurs décisions. L'un des outils interrogés, Rephrasy, nous indique que notre test va pousser l'entreprise à mieux contextualiser les résultats, notamment pour préciser "quand un résultat risque de ne pas être fiable".

À l'image de ZeroGPT, plusieurs de ces outils estiment par ailleurs qu'il est "préférable de combiner les résultats des détecteurs avec la vérification des sources, la vérification de la provenance lorsque cela est possible, la recherche par image inversée et un examen éditorial effectué par des humains."

Auteur d'un guide sur les méthodes de détection d'image générée par IA en septembre 2025 et à l'origine de l'outil ImageWhisperer, qui propose à la fois détection par IA et contextualisation de l'image et de son origine en ligne, Henk Van Ess estime également auprès de la rédaction des Observateurs qu'"un détecteur ne résoudra pas ce type de problème par lui-même, tout comme un journaliste aura du mal à détecter une image sans savoir technique. L'objectif est de faire en sorte que ces deux approches soient associées".